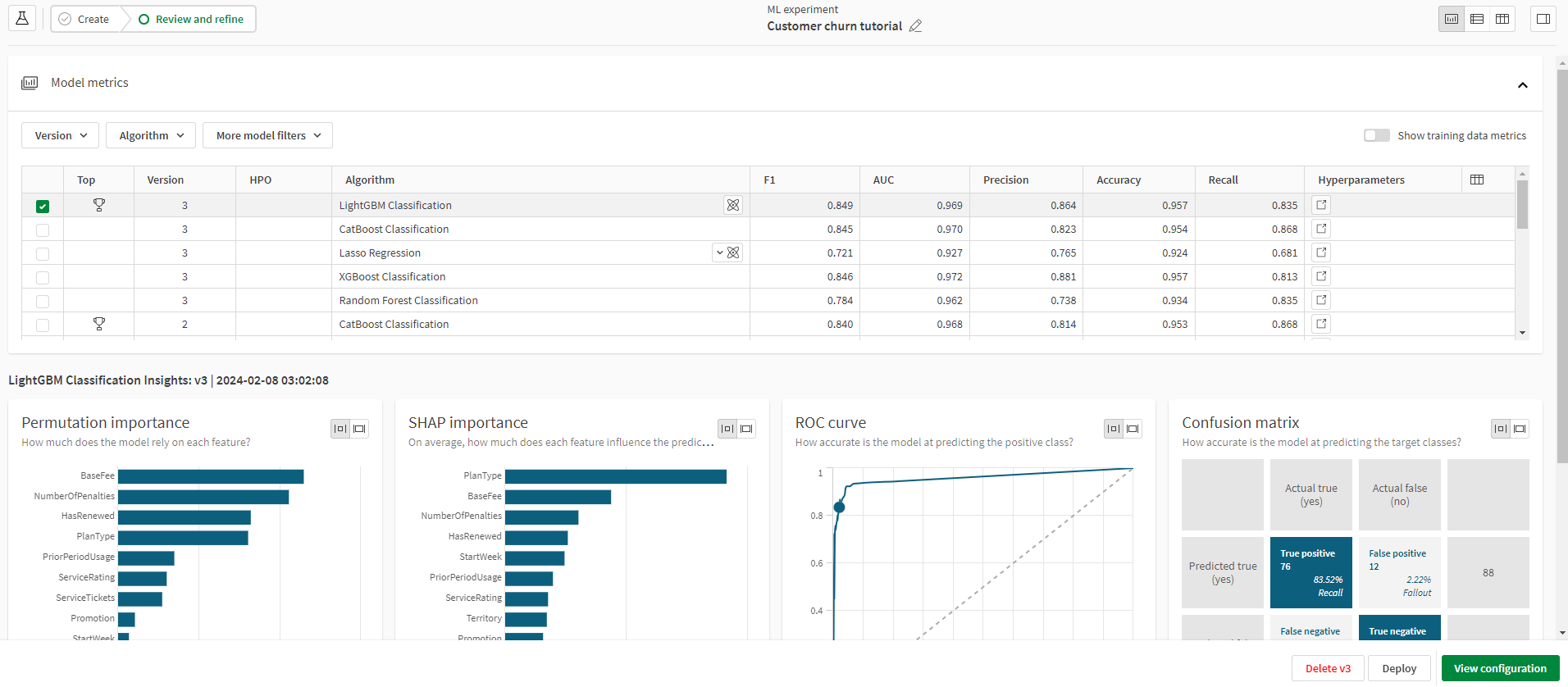

Ver las puntuaciones del modelo

La vista del modelo muestra una recopilación de conocimientos del entrenamiento de algoritmos de aprendizaje automático. Las métricas y los gráficos le permiten comparar diferentes modelos dentro de una versión de experimento o entre diferentes versiones del experimento. Revise las métricas para averiguar qué tal se desempeñó el modelo y cómo puede refinar el modelo para mejorar la puntuación.

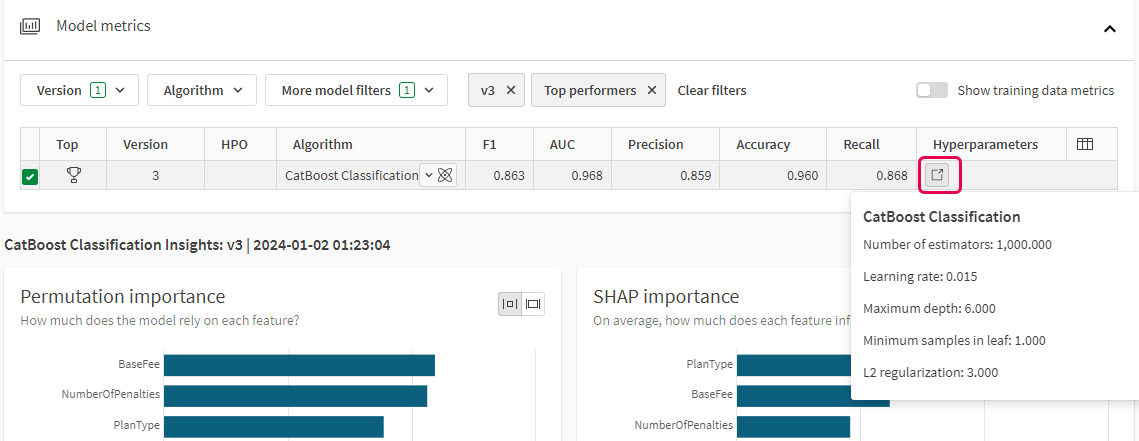

El algoritmo de mejor ajuste para una versión experimental se selecciona automáticamente y se marca con un . La calificación se basa en la puntuación F1 en los modelos de clasificación y la puntuación R2 en los modelos de regresión.

Si un modelo ya se desplegó en una implementación de ML, haga clic en el icono para abrir la implementación. Si se crearon una o más implementaciones a partir del mismo modelo, haga clic en

y luego en

para abrir la implementación de ML deseada.

La vista del modelo con tablas de métricas y visualizaciones de gráficos le permite revisar el rendimiento del modelo

Mostrar las métricas en una tabla

Hay diferentes métricas disponibles según el tipo de problema de aprendizaje automático.

Haga lo siguiente:

-

En la parte superior derecha de la tabla Métricas del modelo, haga clic en

.

-

Seleccione las métricas que desea mostrar.

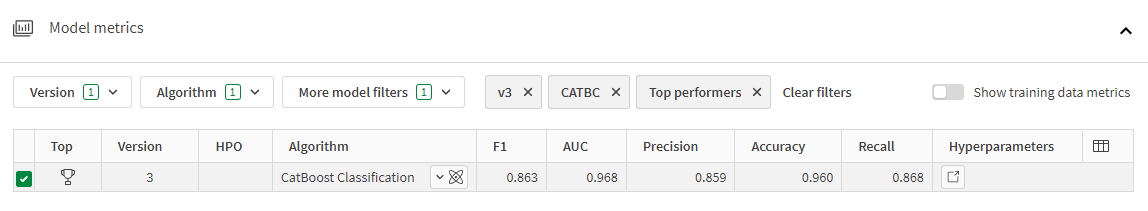

Ver las métricas del modelo

Hay varios filtros que puede usar para ver las métricas del modelo. Expanda los menús desplegables ubicados directamente encima de la tabla Métricas del modelo para explorar las opciones de filtrado de sus modelos.

Puede filtrar los modelos por versión de experimento y algoritmo utilizado. Para incluir las métricas del modelo de mejor rendimiento, utilice el filtro Mejores modelos. El filtro Modelo seleccionado incluirá métricas del modelo para el modelo que ha seleccionado. Utilice el filtro Implementado para incluir métricas de modelos que se han implementado.

Al combinar filtros, se mostrarán las métricas del modelo que coincidan con cualquiera de los filtros aplicados.

Revisar un modelo

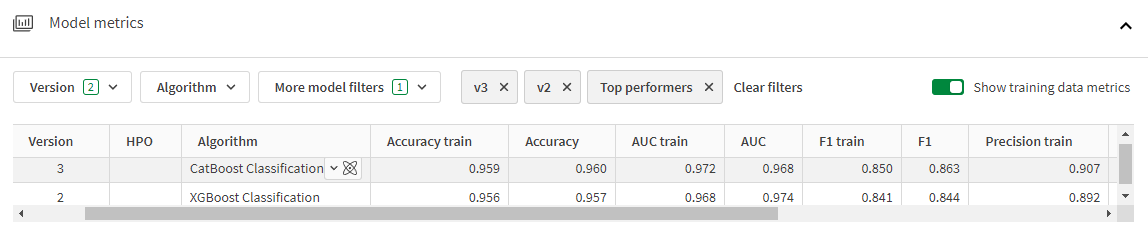

Comparar puntuaciones de retención y puntuaciones de entrenamiento

Las métricas que se muestran en la vista del modelo se basan en los datos de exclusión automática que se utilizan para validar el rendimiento del modelo después del entrenamiento. También puede ver las métricas de entrenamiento que se generaron durante la validación cruzada y compararlas con las métricas retenidas. Active o desactive Mostrar métricas de datos de entrenamiento para mostrar columnas para las puntuaciones del modelo de datos de entrenamiento. Estas puntuaciones a menudo serán similares, pero si varían significativamente es probable que haya un problema de fuga de datos o sobreajuste.

Haga lo siguiente:

-

En la tabla Métricas del modelo, seleccione un modelo.

-

Haga clic en Mostrar métricas de datos de entrenamiento.

Tabla de métricas del modelo con las métricas de los datos de retención y entrenamiento

Ver los valores de hiperparámetros

Puede ver los valores de hiperparámetros utilizados para el entrenamiento por cada algoritmo. Para obtener más información acerca de los hiperparámetros, consulte Optimización de hiperparámetros.

Haga lo siguiente:

-

En la tabla Métricas del modelo, haga clic en

en la columna Hiperparámetros.

Los valores de los hiperparámetros se muestran en una ventana emergente.

Ver los valores de hiperparámetros

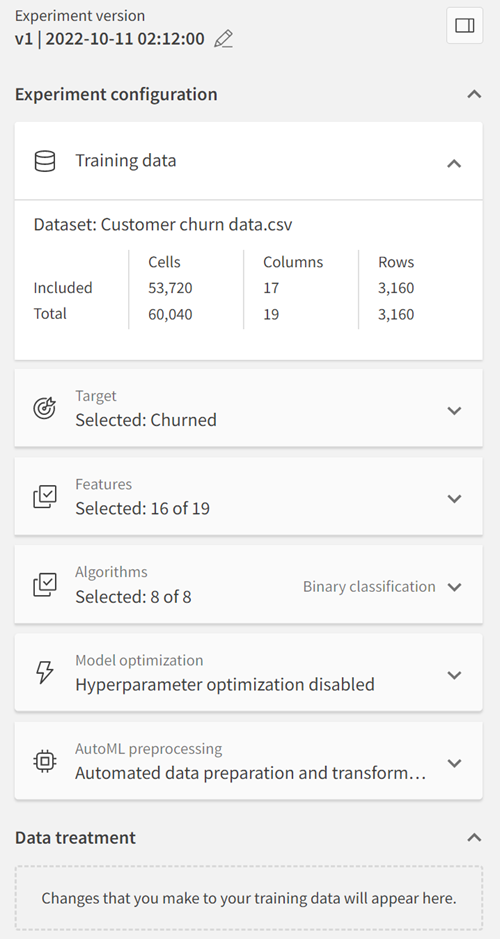

Ver la configuración del experimento

El panel Configuración del experimento muestra la configuración de la versión del experimento para el modelo actualmente seleccionado.

Haga lo siguiente:

-

Seleccione un modelo de una versión del experimento.

-

Haga clic en

o clic en Ver configuración, para abrir el panel Configuración del experimento.

Configuración del experimento