Modellen beoordelen en verfijnen

Nadat de eerste versie van de modeltraining is voltooid, analyseert u de resulterende modelstatistieken en aanbevolen modellen. Als er verdere aanpassingen nodig zijn om de modellen te verfijnen, kunt u extra versies uitvoeren met behulp van handmatige modeloptimalisatie.

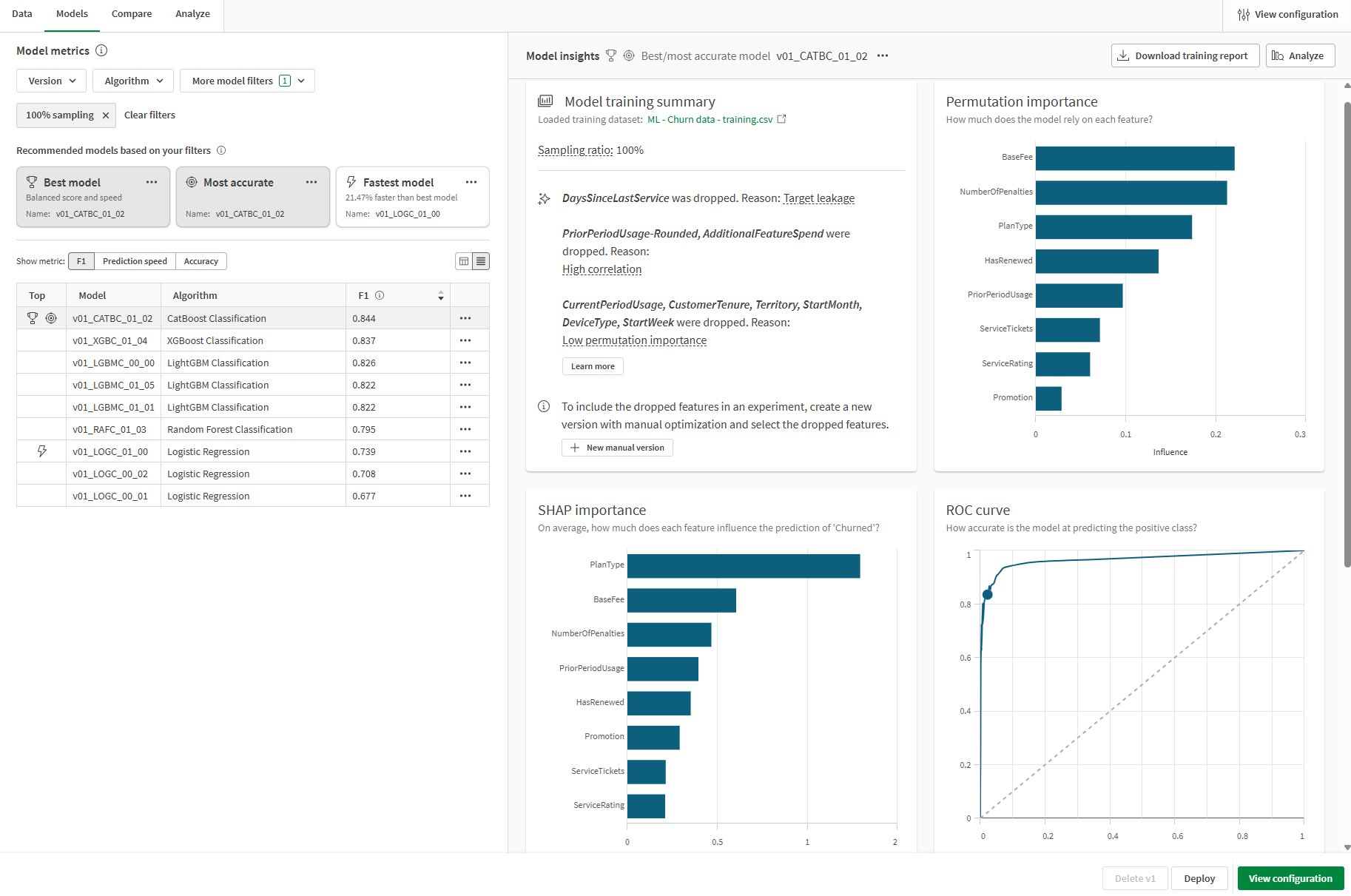

Wanneer u de experimentversie kunt uitvoeren, gaat u naar het tabblad Modellen, waar u kunt beginnen met het analyseren van de resulterende modelstatistieken. U hebt toegang tot Schemaweergave en Gegevensweergave door terug te keren naar het tabblad Gegevens. Meer gedetailleerde analyses kunnen worden uitgevoerd op de tabbladen Vergelijken en Analyseren.

De tabel Modelstatistieken analyseren

Schakel terug naar het tabblad Modellen. In de sectie Modelstatistieken worden aanbevolen modellen gemarkeerd op basis van algemene kwaliteitseisen. Het beste model is automatisch geselecteerd voor analyse.

Er worden drie aanbevelingen gedaan op basis van de modellen die in het experiment zijn getraind. Een enkel model kan in meer dan één aanbeveling worden weergegeven. De aanbevelingen zijn:

-

Beste model: Het model biedt de beste balans tussen uitstekend presterende nauwkeurigheidsstatistieken en voorspellingssnelheid.

-

Meest nauwkeurig: Het model scoort het hoogst op het gebied van gebalanceerde en onbewerkte nauwkeurigheidsstatistieken.

-

Snelste model: Het model heeft de snelste voorspellingssnelheid, naast sterke nauwkeurigheidsgerelateerde statistieken.

Het is belangrijk om het model te kiezen dat het best past bij uw use-case. In de meeste gevallen is het Beste model de meest gunstige optie. Uw voorspellende use-case kan echter specifieke vereisten hebben voor de voorspellingssnelheid of nauwkeurigheidsstatistieken.

Voor een diepgaand overzicht van hoe de beste modeltypen worden bepaald, raadpleegt u Het beste model voor u selecteren.

De tabel Modelstatistieken met aanbevolen modellen en modelstatistieken

U kunt uw focus verfijnen met behulp van de vervolgkeuzefilters boven de aanbevelingen. De beste modeltypen worden automatisch opnieuw berekend telkens wanneer u de filtering wijzigt.

Schakel tussen de kernstatistieken met behulp van de kiezer Metriek weergeven boven de tabel. U kunt modellen sorteren op basis van de naam en de geselecteerde statistiek die wordt geanalyseerd.

Overfitte modellen zijn gemarkeerd met een waarschuwing in de tabel. Deze modellen zijn niet geschikt voor implementatie. Oorzaken van overfitting kunnen onder meer modelcomplexiteit zijn die wordt geïntroduceerd door trainingsalgoritmen, en problemen met de trainingsgegevensset. Raadpleeg voor meer informatie Overfitting.

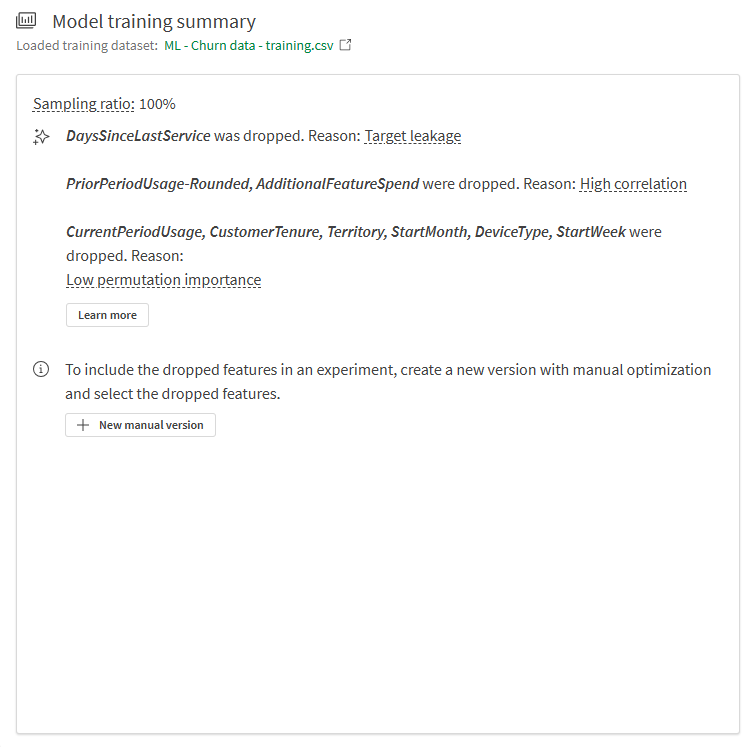

De Samenvatting van modeltraining analyseren

We kunnen ons nu richten op de Samenvatting van modeltraining aan de rechterkant van de interface. Met deze samenvatting kunt u ontdekken hoe het model en de ingevoerde trainingsgegevens zijn geoptimaliseerd voor de beste prestaties. De samenvatting van de modeltraining is een overzicht van de verbeteringen die worden geboden door intelligente modeloptimalisatie.

In de samenvatting in de onderstaande afbeelding kunnen we het volgende zien:

-

Functies uit de trainingsgegevens zijn tijdens de training weggelaten en niet in het model opgenomen.

-

Het model heeft een steekproefverhouding van 100%.

Functie weggelaten vanwege doellekkage

De functie DaysSinceLastService is tijdens de training weggelaten vanwege doellekkage.

In deze functiekolom was tijdens het verzamelen van gegevens geen logica gedefinieerd om het tellen van het aantal dagen sinds het laatste serviceticket van een klant te stoppen voor klanten die hun abonnement hadden opgezegd. Als gevolg hiervan had het model kunnen leren om een groot aantal dagen sinds het laatste serviceticket (aanwezig voor klanten die jaren geleden hebben opgezegd) te koppelen aan een waarde van yes in het veld Churned.

Deze functie moest uit de training worden verwijderd omdat dit zou hebben geleid tot een model met zeer slechte prestaties op nieuwe gegevens.

Het onderliggende probleem staat bekend als doellekkage, wat een vorm van gegevenslekkage is. Raadpleeg voor meer informatie over gegevenslekkage Lekken van gegevens.

Functies weggelaten vanwege hoge correlatie

We kunnen zien dat PriorPeriodUsage-Rounded en AdditionalFeatureSpend zijn weggelaten tijdens de training.

In dit geval was er ten minste één functiekolom—PriorPeriodUsage-Rounded—die rechtstreeks was afgeleid van een andere kolom in de gegevensset. Er zijn andere correlatieproblemen gedetecteerd met AdditionalFeatureSpend.

Het verwijderen van functies die correlatieproblemen veroorzaken, is belangrijk om een kwalitatief model te trainen.

Raadpleeg voor meer informatie over correlatie Correlatie.

Functies weggelaten vanwege gering belang

Verschillende functies zijn ook weggelaten vanwege een lage permutatie-importantie. Na een voorlopige analyse is vastgesteld dat deze functies een zeer geringe invloed hebben op de resultaten van het doel. Deze functies kunnen worden beschouwd als statistische ruis en zijn verwijderd om de modelkwaliteit te verbeteren.

Raadpleeg voor meer informatie over permutatie-importantie Permutatie-urgentie begrijpen.

Samenvatting van modeltraining

Andere visualisaties op het tabblad Modellen analyseren

Er zijn andere visualisaties beschikbaar op het tabblad Modellen voor aanvullende analyses op hoog niveau. Selecteer verschillende modellen in de tabel Modelstatistieken om prestaties op functieniveau en andere diagrammen te verkennen die inzicht kunnen bieden in de modelkwaliteit.

Het tabblad Modellen in ML-experiment met andere visualisaties die beschikbaar zijn voor analyse

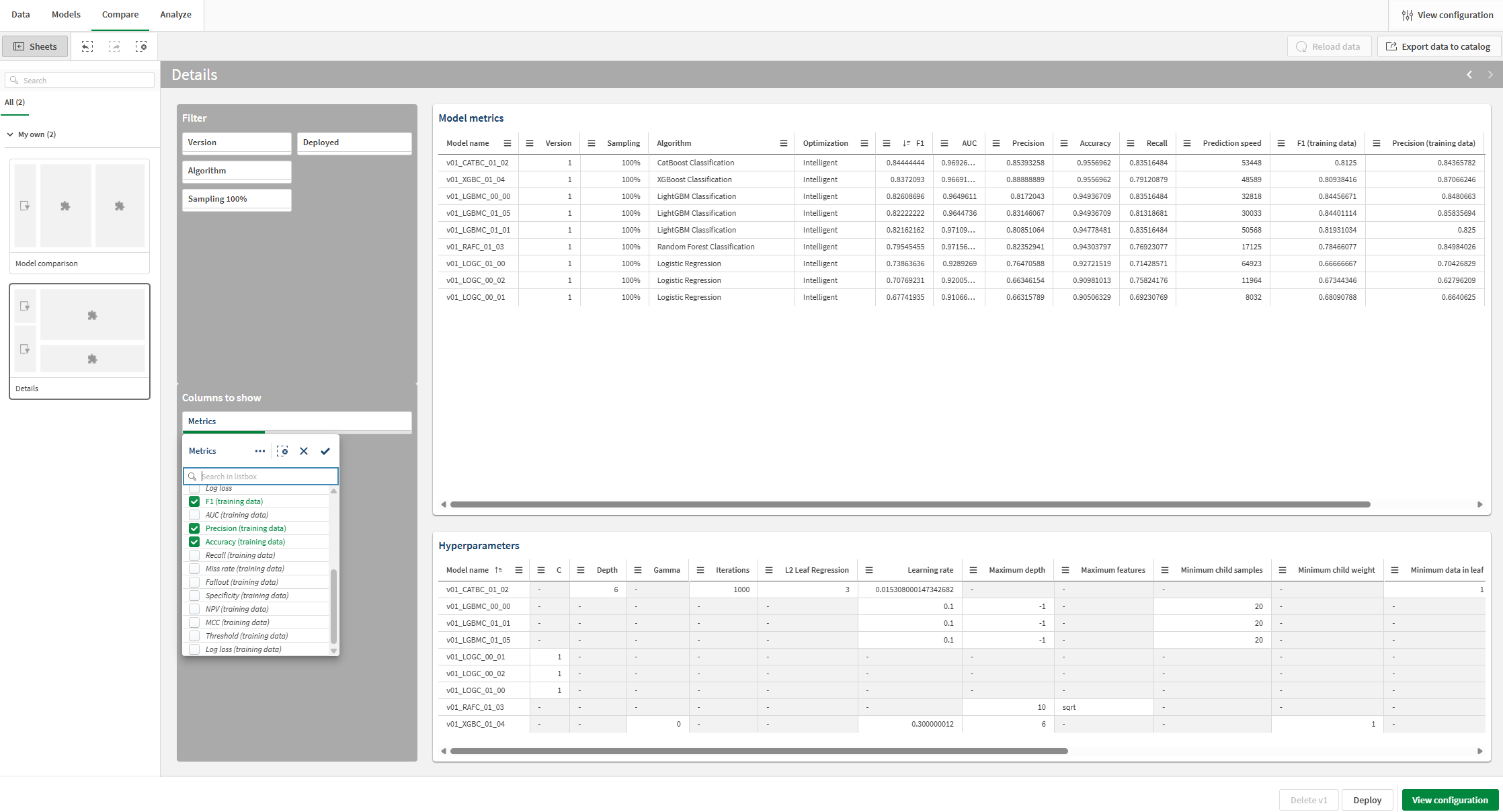

Trainings- en holdout-statistieken vergelijken

U kunt aanvullende statistieken bekijken en de statistieken van de kruisvalidatietraining vergelijken met de holdout-statistieken.

Doe het volgende:

-

Schakel in het experiment over naar het tabblad Vergelijken.

Er wordt een ingebedde analyse geopend. U kunt de interactieve interface gebruiken om dieper in uw vergelijkende modelanalyse te duiken en nieuwe inzichten te ontdekken.

-

In het paneel Werkbladen aan de linkerkant van de analyse schakelt u over naar het werkblad Details.

-

Bekijk de visualisatie Modelstatistieken. Deze toont modelscorestatistieken, zoals F1, evenals andere informatie.

-

In de sectie Weer te geven kolommen gebruikt u het filtervak om kolommen in de tabel toe te voegen en te verwijderen.

-

Voeg in de vervolgkeuzelijst extra statistieken toe. Trainingsscores kunnen aan de tabel worden toegevoegd. U kunt ze naar behoefte toevoegen voor uw analyse.

U kunt nu de F1-statistieken van de kruisvalidatietraining bekijken en deze vergelijken met de holdout-statistieken.

Trainingsscores toevoegen en bekijken ter vergelijking met de holdout-scores

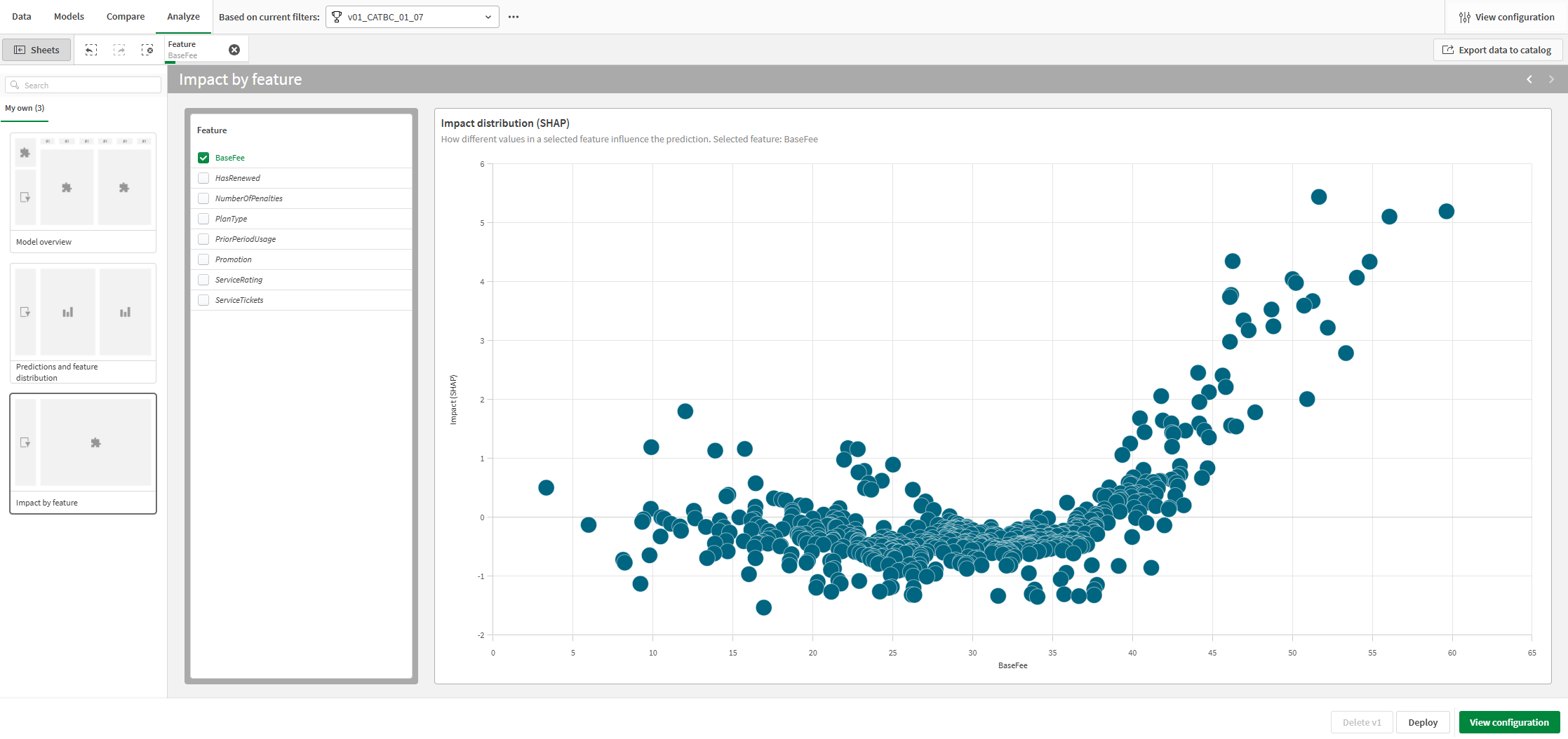

Richten op een specifiek model

Op elk gewenst moment tijdens de modelanalyse kunt u een gedetailleerde analyse van een afzonderlijk model uitvoeren. Ontdek de voorspellingsnauwkeurigheid, functie-importantie en functieverdeling met een interactieve ervaring.

Doe het volgende:

-

Selecteer een model en klik vervolgens op het tabblad Analyseren.

Er wordt een ingebedde analyse geopend.

-

Met het werkblad Modeloverzicht kunt u de voorspellingsnauwkeurigheid van het model analyseren. De analyse wordt versterkt door de kracht van selecties. Klik op een functie of voorspelde waarde om een selectie te maken. De gegevens in de ingebedde analyse worden aangepast om de gegevens te filteren. U kunt inzoomen op specifieke functiewaarden en -bereiken om te zien hoe de functie-invloed en voorspellingsnauwkeurigheid veranderen.

-

Als u overschakelt naar de andere werkbladen, kunt u visualisaties bekijken voor voorspellingsnauwkeurigheid, functieverdeling en invloedsverdeling (SHAP). Deze analytische inhoud kan u helpen om:

-

De belangrijkste factoren te ontdekken die trends in de gegevens beïnvloeden.

-

Te identificeren hoe specifieke functies en cohorten invloed hebben op voorspelde waarden en voorspellingsnauwkeurigheid.

-

Uitschieters in de gegevens te identificeren.

-

Het tabblad Analyseren in een ML-experiment

Volgende stappen

Na het uitvoeren van een versie van het experiment met intelligente modeloptimalisatie, kunt u naar behoefte handmatige versies uitvoeren om uw modellen te verfijnen. Om snel een nieuwe handmatige versie te maken, kunt u terugschakelen naar het tabblad Modellen en klikken op Nieuwe handmatige versie in de Samenvatting van modeltraining.

In een praktijkscenario is het belangrijk om eventuele verfijningsstappen zo vaak als nodig te herhalen voordat u uw model implementeert, om er zeker van te zijn dat u het best mogelijke model hebt voor uw specifieke use-case.

Raadpleeg voor meer informatie over het verfijnen van modellen Modellen verfijnen.

Ga in deze zelfstudie naar de volgende sectie over het implementeren van uw model.