Przeglądanie i udoskonalanie modeli

Po zakończeniu pierwszej wersji szkolenia modelu przeanalizuj uzyskane metryki modelu i rekomendowane modele. Jeśli do udoskonalenia modeli wymagane są dalsze modyfikacje, można uruchomić dodatkowe wersje przy użyciu ręcznej optymalizacji modelu.

Po uruchomieniu wersji eksperymentu następuje przejście do karty Modele, na której można rozpocząć analizę uzyskanych metryk modelu. Dostęp do widoków Widok schematu i Widok danych można uzyskać, wracając do karty Dane. Bardziej szczegółową analizę można przeprowadzić na kartach Porównaj i Analizuj.

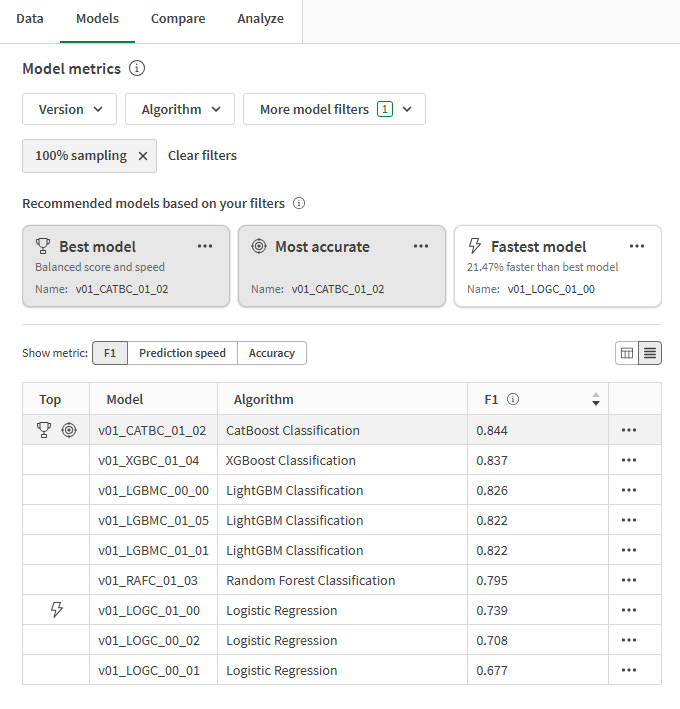

Analiza tabeli Metryki modelu

Przełącz się z powrotem na kartę Modele. W sekcji Metryki modelu rekomendowane modele są wyróżnione na podstawie typowych wymagań jakościowych. Najlepszy model został automatycznie wybrany do analizy.

W ramach modeli przeszkolonych w eksperymencie dostępne są trzy rekomendacje. Pojedynczy model może być reprezentowany w więcej niż jednej rekomendacji. Rekomendacje to:

-

Najlepszy model: model, który najlepiej równoważy najwyższe metryki dokładności i szybkość przewidywania.

-

Najdokładniejszy: model uzyskujący najwyższe wyniki w zrównoważonych i surowych metrykach dokładności.

-

Najszybszy model: model o najszybszym tempie przewidywania, a także o silnych metrykach związanych z dokładnością.

Ważne jest, aby wybrać model najlepiej dopasowany do danego przypadku użycia. W większości przypadków Najlepszy model jest najkorzystniejszą opcją. Jednak dany przypadek użycia predykcyjnego może wymagać określonych specyfikacji dotyczących szybkości przewidywania lub metryk dokładności.

Szczegółowy przegląd sposobu określania najlepszych typów modeli zawiera sekcja Wybór najlepszego modelu dla siebie.

Tabela Metryki modelu przedstawiająca rekomendowane modele i metryki modeli

Możesz zawęzić obszar zainteresowania, korzystając z filtrów rozwijanych nad rekomendacjami. Najlepsze typy modeli są automatycznie przeliczane przy każdej zmianie filtrowania.

Przełączaj się między podstawowymi metrykami za pomocą selektora Pokaż metrykę nad tabelą. Modele można sortować na podstawie nazwy i wybranej analizowanej metryki.

Modele przeuczone są oznaczone w tabeli ostrzeżeniem . Modele te nie nadają się do wdrożenia. Przyczyny przeuczenia mogą obejmować złożoność modelu wprowadzoną przez algorytmy szkoleniowe oraz problemy z zestawem danych szkoleniowych. Więcej informacji zawiera sekcja Przetrenowanie.

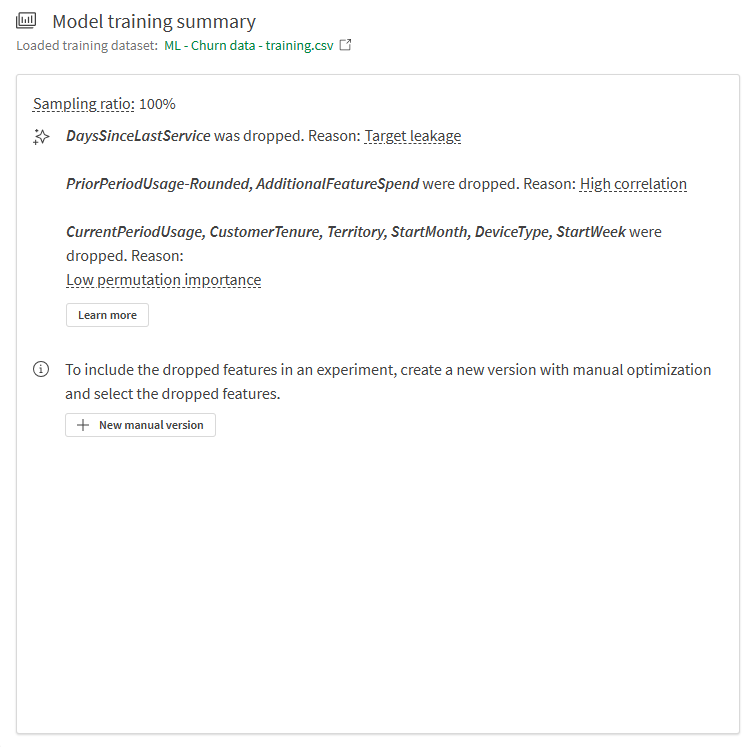

Analiza sekcji Podsumowanie szkolenia modelu

Możemy teraz skupić się na sekcji Podsumowanie szkolenia modelu po prawej stronie interfejsu. Podsumowanie to pozwala zbadać, w jaki sposób model i wejściowe dane szkoleniowe zostały zoptymalizowane pod kątem najlepszej wydajności. Podsumowanie szkolenia modelu to przegląd ulepszeń zapewnianych przez inteligentną optymalizację modelu.

Z podsumowania na poniższym obrazie wynika, że:

-

Cechy z danych szkoleniowych zostały odrzucone podczas szkolenia i nie zostały włączone do modelu.

-

Model ma współczynnik próbkowania wynoszący 100%.

Cecha odrzucona z powodu wycieku celu

Cecha DaysSinceLastService została odrzucona podczas szkolenia z powodu wycieku celu.

W tej kolumnie cechy nie zdefiniowano żadnej logiki podczas zbierania danych, która zatrzymałaby odliczanie liczby dni od ostatniego zgłoszenia serwisowego klienta w przypadku klientów, którzy anulowali subskrypcję. W rezultacie model mógł nauczyć się kojarzyć dużą liczbę dni od ostatniego zgłoszenia serwisowego (występującą u klientów, którzy zrezygnowali lata temu) z wartością yes w polu Churned.

Tę cechę należało usunąć ze szkolenia, ponieważ doprowadziłaby ona do powstania modelu o bardzo słabej wydajności na nowych danych.

Problem leżący u podstaw jest znany jako wyciek celu, który jest formą wycieku danych. Więcej informacji na temat wycieku danych zawiera sekcja Wyciek danych.

Cechy odrzucone z powodu wysokiej korelacji

Widzimy, że cechy PriorPeriodUsage-Rounded i AdditionalFeatureSpend zostały odrzucone podczas szkolenia.

W tym przypadku istniała co najmniej jedna kolumna cechy — PriorPeriodUsage-Rounded — która została bezpośrednio pochodna od innej kolumny w zestawie danych. Inne problemy z korelacją wykryto w przypadku cechy AdditionalFeatureSpend.

Usunięcie cech powodujących problemy z korelacją jest ważne dla wyszkolenia modelu wysokiej jakości.

Więcej informacji na temat korelacji zawiera sekcja Korelacja.

Cechy odrzucone z powodu niskiego znaczenia

Kilka cech zostało również odrzuconych z powodu niskiego znaczenia permutacji. Po wstępnej analizie cechy te zostały zidentyfikowane jako mające bardzo niski wpływ na wyniki celu. Cechy te można uznać za szum statystyczny i zostały one usunięte w celu poprawy jakości modelu.

Więcej informacji na temat znaczenia permutacji zawiera sekcja Omówienie ważności permutacji.

Podsumowanie szkolenia modelu

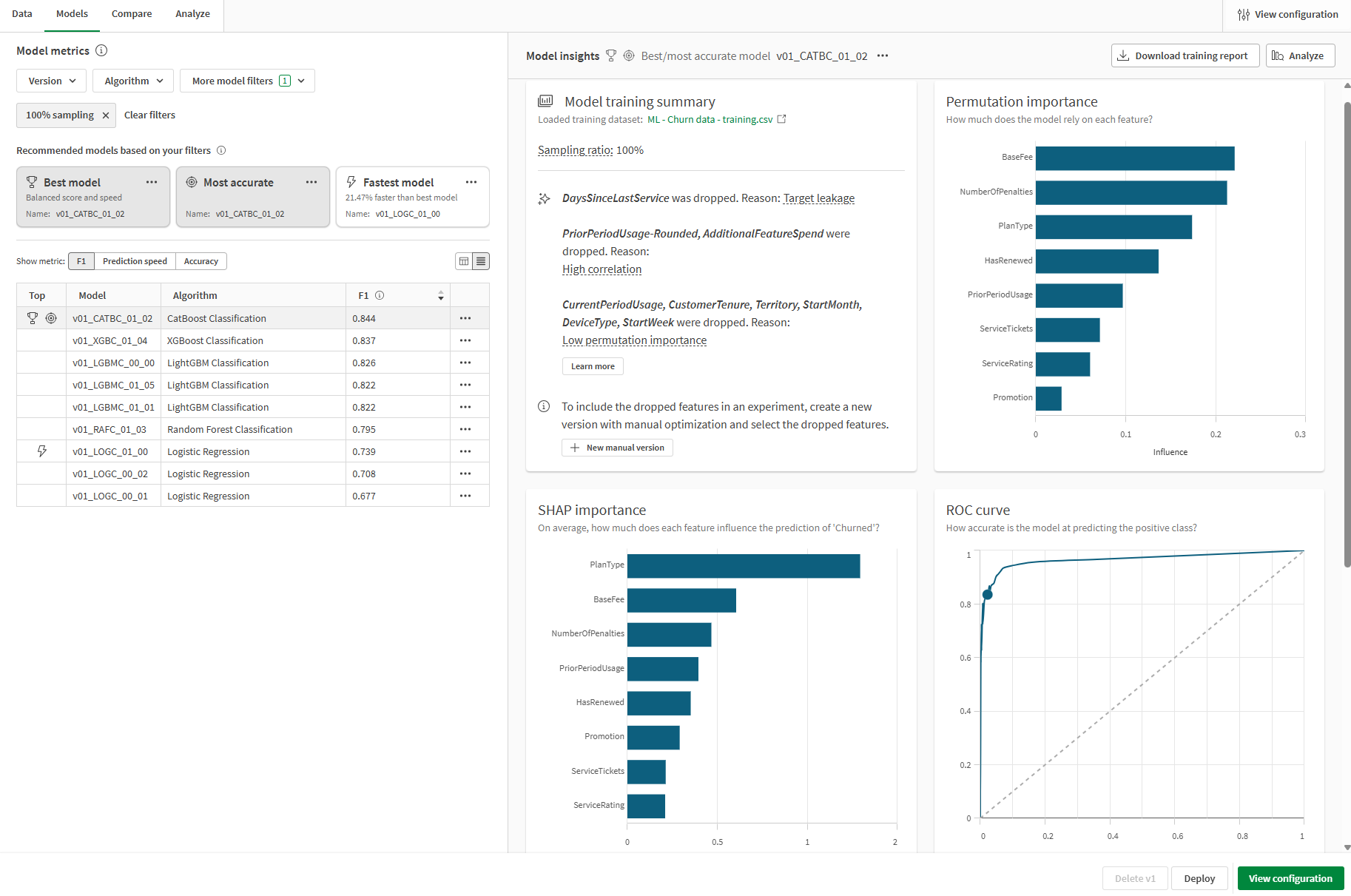

Analiza innych wizualizacji na karcie Modele

Inne wizualizacje są dostępne na karcie Modele do dodatkowej analizy na wysokim poziomie. Wybierz różne modele w tabeli Metryki modelu, aby zbadać wydajność na poziomie cech i inne wykresy, które mogą zaoferować wgląd w jakość modelu.

Karta Modele w eksperymencie ML pokazująca inne wizualizacje dostępne do analizy

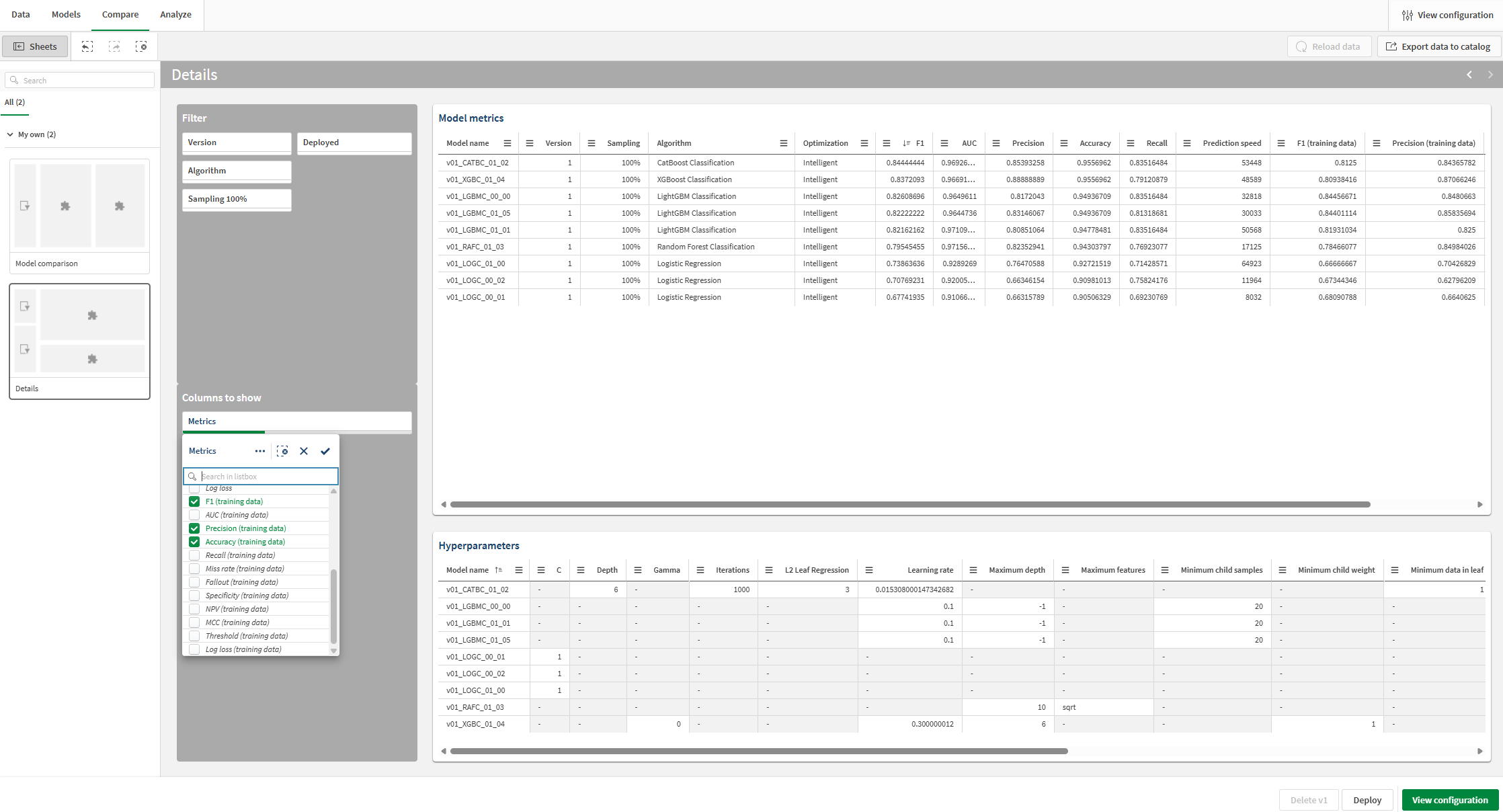

Porównywanie metryk szkoleniowych i wstrzymanych

Możesz wyświetlić dodatkowe metryki i porównać metryki ze szkolenia walidacji krzyżowej z metrykami wstrzymanymi.

Wykonaj następujące czynności:

-

W eksperymencie przejdź do karty Porównaj.

Zostanie otwarta osadzona analiza. Możesz użyć interaktywnego interfejsu, aby zagłębić się w porównawczą analizę modeli i odkryć nowe spostrzeżenia.

-

W panelu Arkusze po lewej stronie analizy przejdź do arkusza Szczegóły.

-

Spójrz na wizualizację Metryki modelu. Pokazuje ona metryki oceny modelu, takie jak F1, a także inne informacje.

-

W sekcji Kolumny do pokazania użyj panelu filtrowania, aby dodać i usunąć kolumny w tabeli.

-

Na rozwijanej liście dodaj dodatkowe metryki. Wyniki szkolenia są dostępne do dodania do tabeli. Możesz je dodać w zależności od potrzeb analizy.

Możesz teraz zobaczyć metryki F1 ze szkolenia walidacji krzyżowej i porównać je z metrykami wstrzymanymi.

Dodawanie i wyświetlanie wyników szkolenia w celu porównania z wynikami wstrzymanymi

Skupienie się na konkretnym modelu

W dowolnym momencie analizy modelu można przeprowadzić szczegółową analizę poszczególnych modeli. Poznaj dokładność przewidywania, znaczenie cech i rozkład cech dzięki interaktywnemu środowisku.

Wykonaj następujące czynności:

-

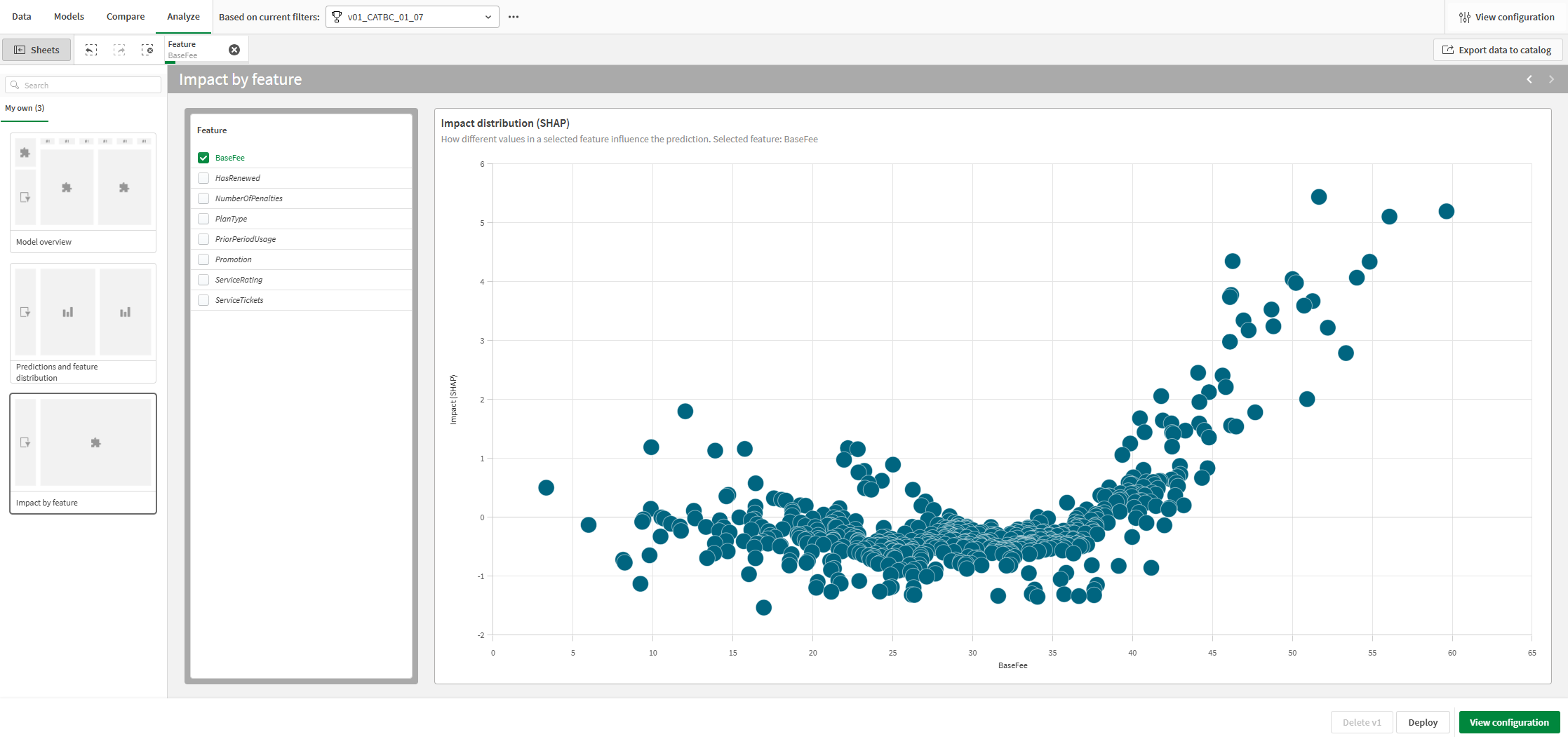

Wybierz dowolny model, a następnie kliknij kartę Analizuj.

Zostanie otwarta osadzona analiza.

-

Dzięki arkuszowi Przegląd modelu można analizować dokładność przewidywania modelu. Analiza jest ulepszona dzięki potędze wyborów. Kliknij cechę lub przewidywaną wartość, aby dokonać wyboru. Dane w osadzonej analizie dostosują się, aby przefiltrować dane. Możesz przejść do szczegółów określonych wartości i zakresów cech, aby zobaczyć, jak zmieniają się wpływ cech i dokładność przewidywania.

-

Przełączając się na inne arkusze, można wyświetlić wizualizacje dokładności przewidywania, rozkładu cech i rozkładu wpływu (SHAP). Ta zawartość analityczna może pomóc w:

-

Odkryciu kluczowych czynników wpływających na trendy w danych.

-

Zidentyfikowaniu, jak określone cechy i kohorty wpływają na przewidywane wartości i dokładność przewidywania.

-

Zidentyfikowaniu wartości odstających w danych.

-

Karta Analizuj w eksperymencie ML

Następne kroki

Po uruchomieniu wersji eksperymentu z inteligentną optymalizacją modelu można w razie potrzeby uruchomić wersje ręczne w celu udoskonalenia modeli. Aby szybko utworzyć nową wersję ręczną, możesz przełączyć się z powrotem na kartę Modele i kliknąć przycisk Nowa wersja ręczna w sekcji Podsumowanie szkolenia modelu.

W rzeczywistym scenariuszu ważne jest, aby powtórzyć wszelkie kroki udoskonalania tyle razy, ile to konieczne, przed wdrożeniem modelu, aby upewnić się, że dysponuje się najlepszym możliwym modelem dla konkretnego przypadku użycia.

Więcej informacji na temat udoskonalania modeli zawiera sekcja Dopracowywanie modeli.

W tym samouczku przejdź do następnej sekcji dotyczącej wdrażania modelu.