Définir les paramètres de connexion à Cloudera avec Spark Universal

Pourquoi et quand exécuter cette tâche

Le Studio Talend se connecte à un cluster Cloudera afin d'exécuter le Job depuis ce cluster.

Procédure

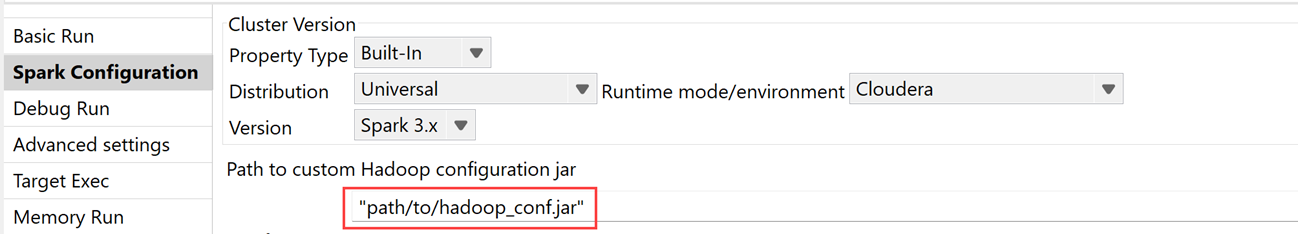

- Cliquez sur la vue Run sous l'espace de modélisation graphique, puis cliquez sur la vue Spark configuration.

-

Sélectionnez Built-in dans la liste déroulante Property type.

Si vous avez déjà configuré les paramètres de connexion dans le Repository, comme expliqué dans Centraliser une connexion à Hadoop, vous pouvez réutiliser ces paramètres. Pour ce faire, sélectionnez Repository dans la liste Property type, cliquez sur le bouton [...] pour ouvrir la boîte de dialogue Repository Content et sélectionnez la connexion à Hadoop à utiliser.Note InformationsConseil : Configurer la connexion dans le Repository vous permet d'éviter de configurer cette connexion chaque fois que vous en avez besoin dans la vue Spark Configuration de vos Jobs Spark. Les champs sont automatiquement renseignés.

-

Sélectionnez Universal dans la liste déroulante Distribution, la version Spark de votre choix dans la liste déroulante Version et Cloudera dans la liste déroulante Runtime mode/environment (Mode/environnement du Runtime).

Le mode Cloudera supporte uniquement les versions 3.x de Spark.

-

Saisissez le chemin du fichier JAR de configuration Hadoop avec les paramètres de connexion pour votre cluster Cloudera.

Le fichier JAR contient toutes les informations nécessaires pour établir une connexion à tous les fichiers *-site.xml du cluster.

Le fichier JAR doit inclure les fichiers XML suivants :

Le fichier JAR doit inclure les fichiers XML suivants :- hdfs-site.xml

- core-site.xml :

- yarn-site.xml :

- mapred-site.xml

Si vous utilisez des composants Hive ou HBase, le fichier JAR doit inclure, en plus et respectivement, les fichiers XML suivants :- hive-site.xml

- hbase-site.xml

-

Si vous exécutez votre Job Spark sous Windows, spécifiez l'emplacement du programme winutils.exe :

- Si vous souhaitez utiliser votre propre fichier winutils.exe, cochez la case Define the Hadoop home directory (Définir le répertoire Home Hadoop) et saisissez son chemin d'accès.

- Sinon, laissez la case Define the Hadoop home directory décochée. Le Studio Talend va générer un répertoire et l'utiliser automatiquement pour ce Job.

-

Saisissez les informations simples de configuration :

Paramètre Utilisation Use custom classpath Cochez cette case pour spécifier les entrées des classpath supplémentaires pour les Jobs Spark, vous permettant d'inclure des bibliothèques et dépendances personnalisées lorsque vous effectuez des exécutions sur un cluster YARN. Use local timezone Cochez cette case pour laisser Spark utiliser le fuseau horaire local fourni par le système. Note InformationsRemarque :- Si vous décochez cette case, Spark utilise le fuseau horaire UTC.

- Certains composants ont également une case Use local timezone for date. Si vous décochez la case du composant, il hérite du fuseau horaire de la configuration Spark.

Use dataset API in migrated components Cochez cette case pour laisser les composants utiliser l'API Dataset (DS) au lieu de l'API RDD (Resilient Distributed Dataset) : - Si vous cochez la case, les composants dans le Job s'exécutent avec DS, ce qui améliore les performances.

- Si vous décochez la case, les composants dans le Job s'exécutent avec RDD, ce qui signifie que le Job reste inchangé. Cela assure la rétrocompatibilité.

Cette case est cochée par défaut, mais, si vous importez des Jobs depuis une version 7.3 vers une plus ancienne, la case sera décochée, car ces Jobs s'exécutent avec RDD.

Note InformationsImportant : Si votre Job contient les composants tDeltaLakeInput et tDeltaLakeOutput, vous devez cocher cette case.Use timestamp for dataset components Cochez cette case pour utiliser java.sql.Timestamp pour les dates. Note InformationsRemarque : Si vous laissez cette case décochée, java.sql.Timestamp ou java.sql.Date peut être utilisé, selon le modèle.Batch size (ms) Saisissez l'intervalle de temps à la fin duquel le Job Spark Streaming revoit la source de données pour identifier les modifications et traite les nouveaux micro-batchs. Define a streaming timeout (ms) Cochez cette case et, dans le champ qui s'affiche, saisissez la période de temps à la fin de laquelle le Job Spark Streaming s'arrête automatiquement. Note InformationsRemarque : Si vous utilisez Windows 10, il est recommandé de configurer un délai avant expiration raisonnable pour éviter que Windows Service Wrapper rencontre un problème lors de l'envoi d'un signal d'arrêt depuis les applications Java. Si vous rencontrez cette erreur, vous pouvez annuler l'exécution du Job manuellement, depuis votre espace de travail Azure Synapse Analytics.Parallelize output files writing (Paralléliser l'écriture des fichiers de sortie) Cochez cette case pour permettre au Job Spark Batch d'exécuter plusieurs threads en parallèle lors de l'écriture de fichiers de sortie. Cette option améliore les performances du temps d'exécution. Lorsque vous laissez cette case décochée, les fichiers de sortie sont écrits en séquence dans un thread.

Au niveau des sous-Jobs, chacun est traité en séquence. Seul le fichier de sortie contenu dans le sous-Job est parallélisé.

Cette option est disponible uniquement pour les Jobs Spark Batch contenant les composants de sortie suivants :- tAvroOutput

- tFileOutputDelimited (uniquement lorsque la case Use dataset API in migrated components (Utiliser l'API Dataset dans les composants migrés) est cochée)

- tFileOutputParquet

Note InformationsImportant : Pour éviter les problèmes de mémoire au cours de l'exécution du Job, vous devez prendre en compte la taille des fichiers en cours d'écriture et la capacité de l'environnement d’exécution utilisant ce paramètre. - Saisissez les informations d'authentification en spécifiant votre identifiant. Vous pouvez également utiliser Kerberos pour vous authentifier, en cochant la case Use Kerberos authentication (Utiliser l'authentification Kerberos).

-

Cochez la case Set tuning properties (Configurer les propriétés d'ajustement) pour définir les paramètres d'ajustement, en suivant le processus présenté dans Personnaliser Spark pour les Jobs Apache Spark Batch.

Note InformationsImportant : Vous devez définir les paramètres d'ajustement, sinon vous risquez d'obtenir une erreur (400 - Requête incorrecte).

-

Cochez la case Enable spark event logging pour activer les logs de l'application Spark du Job à faire persister dans le système de fichiers.

Les paramètres relatifs aux logs Spark s'affichent :

- Compress Spark event logs : cochez cette case pour compresser les logs.

- Spark event logs directory : saisissez le répertoire où sont enregistrés les événements Spark.

- Spark history server address : saisissez l'emplacement du serveur de l'historique.

Votre administrateur·trice de cluster peut avoir défini ces propriétés dans les fichiers de configuration. Contactez l'administrateur·trice pour obtenir les valeurs exactes.

-

Dans le champ Spark "scratch" directory, saisissez le chemin du répertoire local dans lequel le Studio Talend stocke les fichiers temporaires.

Si vous exécutez votre Job sous Windows, le disque par défaut est C:. Laisser /tmp dans ce champ utilise C:/tmp comme répertoire.

-

Cochez la case Wait for the Job to complete (En attente de la fin du Job) pour que le Studio Talend ou, si vous utilisez Talend JobServer, la JVM de votre Job continue à monitorer le Job jusqu'à la fin de son exécution.

En cochant cette case, vous configurez la propriété spark.yarn.submit.waitAppCompletion à true. Il est généralement utile de cocher cette case lors de l'exécution d'un Job Spark Batch, mais il est encore plus sensé de la laisser décochée lors de l'exécution d'un Job Spark Streaming.

-

Pour rendre votre Job résistant aux échecs, sélectionnez Activate checkpointing (Activer les points de contrôle) pour activer l'opération de points de contrôle Spark.

Dans le champ Checkpoint directory (Répertoire des points de contrôle), saisissez le chemin d'accès au fichier système du cluster dans lequel Spark enregistre les données de contexte, comme les métadonnées et les RDD générés.

- Dans la table Advanced properties (Propriétés avancées), ajoutez toute propriété Spark dont vous souhaitez écraser la valeur par défaut configurée par le Studio Talend.

Résultats

Cette page vous a-t-elle aidé ?

Si vous rencontrez des problèmes sur cette page ou dans son contenu – une faute de frappe, une étape manquante ou une erreur technique – faites-le-nous savoir.