Neue Funktionen

Big Data

| Funktion | Beschreibung |

|---|---|

| Unterstützung für Amazon Athena-Konnektivität, die Interoperabilität mit Open Lakehouse in Spark-Batch-Aufträgen zulässt | Amazon Athena wird jetzt in Ihren Spark-Batch-Aufträgen mit den folgenden Komponenten unterstützt:

Sie können eine Verbindung mit Athena herstellen und Daten lesen. Das Schreiben von Daten in Athena ist nicht möglich. |

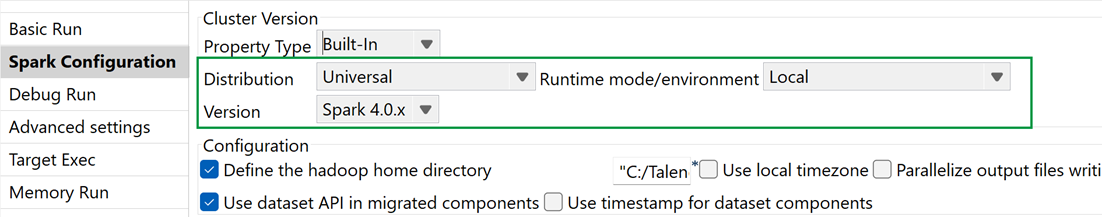

| Unterstützung für Spark Universal 4.0.2 in Spark-Batch-Jobs im lokalen Laufzeitmodus | Sie können Ihre Spark Batch-Jobs jetzt mit Spark 4.0.x im lokalen Modus (Local) ausführen. Die Konfiguration erfolgt entweder in der Ansicht Spark Configuration (Spark-Konfiguration) Ihrer Spark-Jobs oder im Metadaten-Assistenten Hadoop Cluster Connection (Hadoop-Clusterverbindung). Die folgenden Komponenten werden mit Spark 4.0.x nicht unterstützt:

|

Datenintegration

| Funktion | Beschreibung |

|---|---|

| Unterstützung für Amazon Athena-Konnektivität, die Interoperabilität mit Open Lakehouse in Standard-Jobs zulässt |

Die generischen Datenbankkomponenten unterstützen jetzt offiziell die Verbindung zu Amazon Athena, und die folgenden Komponenten wurden zur Auswahl hinzugefügt:

|

| Unterstützung für S3 Express One Zone-Verzeichnis-Buckets für Amazon S3-Komponenten in Standard-Jobs | Die S3-Komponenten unterstützen jetzt Amazon S3 Express One Zone-Verzeichnis-Buckets. Für Verzeichnis-Buckets sind Standard-AWS-Anmeldeinformationen und entsprechende IAM-Berechtigungen für regionale Endpunktvorgänge erforderlich. |

| Neue Autorisierungsmethode für BigQuery-Komponenten zur Verwendung des empfohlenen OAuth 2.0-Autorisierungscodes in Standard-Jobs | Der Authentifizierungsmodus OAuth 2.0 (Authorization Code grant) (OAuth 2.0 (Gewährung des Autorisierungscodes)) wurde zu den BigQuery-Komponenten hinzugefügt. Die Autorisierung wird über einen einmaligen Browser-Fluss abgeschlossen, der über die Konsole Run (Ausführen) erfolgt. Die Konfiguration wird dann gespeichert, sodass nachfolgende Jobausführungen ohne Wiederholung der Einrichtung auf BigQuery zugreifen können. |

| Neue Eigenschaft in der tEmbeddingAI-Komponente, damit Benutzer die Basis-URL für KI-Plattformen in Standard-Jobs definieren können | Die Option Base URL (Basis-URL) wurde in der tEmbeddingAI-Komponente zu Advanced settings (Erweiterte Einstellungen) hinzugefügt, damit Sie die Basis-URL-Adresse des API-Servers eingeben können, auf den Sie zugreifen möchten. Diese Option ist für die Plattformen Ali Bailian, Cohere, Hugging Face und Mistral AI verfügbar. |

Data Mapper

| Funktion | Beschreibung |

|---|---|

| Unterstützung für das Kopieren und Einfügen von Schemaspalten aus einer Komponente in eine Struktur | Sie können jetzt Schemaspalten aus Talend Studio-Komponenten kopieren und sie als Elemente in hierarchische Mapper-Strukturen einfügen. Die Schemaspalten werden automatisch in Strukturelemente mit den entsprechenden Datentypen konvertiert. Sie können Spalten entweder als untergeordnete oder als gleichgeordnete Elemente einfügen. Weitere Informationen finden Sie unter Kopieren von Schemaspalten aus Studio-Komponenten. |

| Unterstützung für HTTP- und HTTPS-Schemas in der ReadURL-Funktion in der Nicht-Eclipse-Laufzeit | Die ReadURL-Funktion unterstützt jetzt HTTP- und HTTPS-Schemas in der Nicht-Eclipse-Laufzeit. |

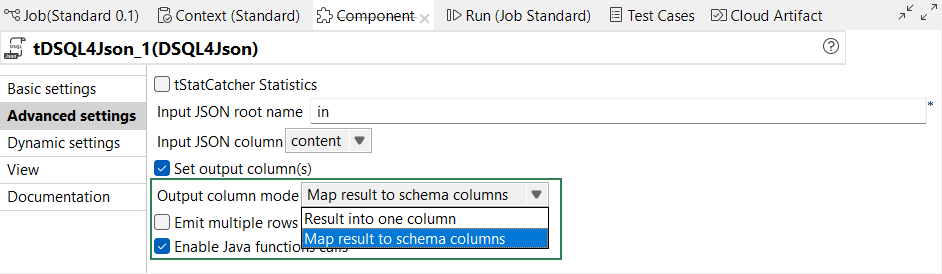

| Verbesserung der Schemaspalten-Ausgabeoptionen in tDSQL4JSON | Die Option Set output column(s) (Ausgabespalte(n) festlegen) wurde verbessert und lässt die Auswahl zu, wie JSON-Umwandlungsergebnisse zugeordnet werden. Mit der neuen Dropdown-Liste Output column mode (Ausgabespaltenmodus) können Sie wählen, die JSON-Ausgabe entweder zu mehreren Schemaspalten oder zu einer einzelnen Spalte zuzuordnen. |

Datenqualität

| Funktion | Beschreibung |

|---|---|

| Unterstützung für weitere Operatoren in tDQRules | Sie können jetzt die folgenden Operatoren in der tDQRules-Komponente verwenden:

Die Unterscheidung der Groß-/Kleinschreibung in den String-Operatoren wird jetzt ebenfalls unterstützt. |

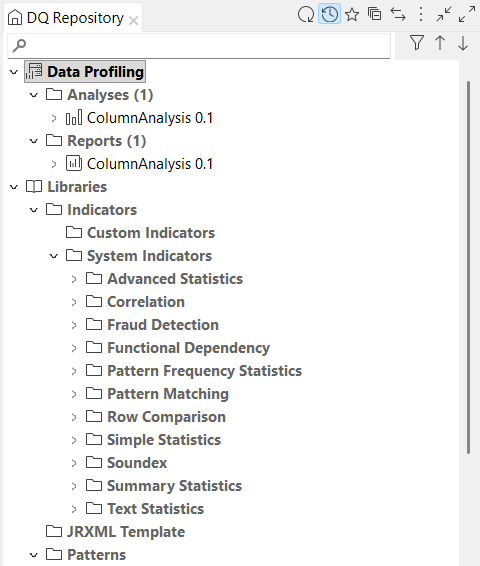

| Anzeigen kürzlich verwendeter Elemente | Sie können jetzt die kürzlich verwendeten Elemente anzeigen. |