클래스 균형 조정

이진 분류 문제에서는 두 클래스 중 하나에 대해 더 많은 데이터가 수집될 수 있습니다. 클래스 간의 이러한 불균형으로 인해 모델은 소수 클래스보다 다수 클래스에 대해 더 많이 학습하게 합니다. 클래스 균형 조정을 사용하여 모델을 개선할 수 있습니다.

클래스 균형란?

이진 분류를 위한 데이터 집합에는 두 개의 클래스가 있습니다. 클래스 균형은 해당 클래스의 상대적 빈도입니다.

완벽하게 임의의 동전을 충분히 여러 번 던지면 완벽하게 균형 있는 두 클래스(앞면과 뒷면) 집합을 얻게 됩니다. 평균 클래스 값은 완벽하게 균형 있는 경우(한 클래스는 1이고 다른 클래스는 0임)에서 0.5입니다.

완벽하게 균형 있는 두 클래스

많은 경우에 클래스 균형은 동일하지 않습니다. 이로 인해 모델이 소수 클래스보다 다수 클래스에 대해 더 많이 학습할 수 있습니다.

불균형 클래스의 예

비례 편향

모델은 불균형 데이터의 대다수 클래스를 추측하여 매우 정확할 수 있습니다. 예를 들어, 웹사이트 방문자의 95%가 구매하지 않는 경우 아무도 구매하지 않을 것이라고 말하는 모델은 95% 정확할 수 있습니다. 모델은 다수 클래스에 대해 학습하지만 종종 소수 클래스에 대해 학습하는 것이 더 중요합니다. 예를 들어, 웹사이트 방문자의 나머지 5%가 구매하는 이유는 무엇입니까?

클래스 균형 조정 효과

데이터에 대해 클래스 균형 조정을 수행하면 더 기능에 중점을 두고 소수 클래스에 대해 더 많이 학습한 모델을 가져올 수 있습니다. 모델에 대한 잠재적 영향은 다음과 같습니다.

-

소수 클래스의 비중이 높아졌으므로 F1 점수가 높아집니다.

-

비례 편향에 크게 의존하지 않으므로 전체 정확도 점수가 약간 낮아집니다.

-

기능과 클래스를 분리된 것으로 구별하는 방법에 더 의존하므로 더 많은 정보를 제공하는 모델입니다. SHAP 값은 클래스 균형이 조정된 모델에서 더 많은 정보를 제공할 수 있습니다.

작은 데이터 집합에서 클래스 균형 조정으로 인해 기능 데이터가 손실될 수 있습니다. 또한 데이터 집합의 비율을 변경하면 일부 정보가 손실되어 모델 예측이 편향될 수 있습니다.

클래스 균형 조정 방법

데이터의 클래스 균형을 맞추려면 먼저 특정 비즈니스 사례에 이상적인 균형이 무엇인지 찾아야 합니다. 80/20에서 50/50까지 어디에서나 필요할 수 있습니다. 클래스 균형을 과도하게 조정하면 모델이 과적합될 수 있으므로 필요한 만큼만 균형을 조정하십시오. 그런 다음 수동 홀드아웃으로 모델을 테스트합니다.

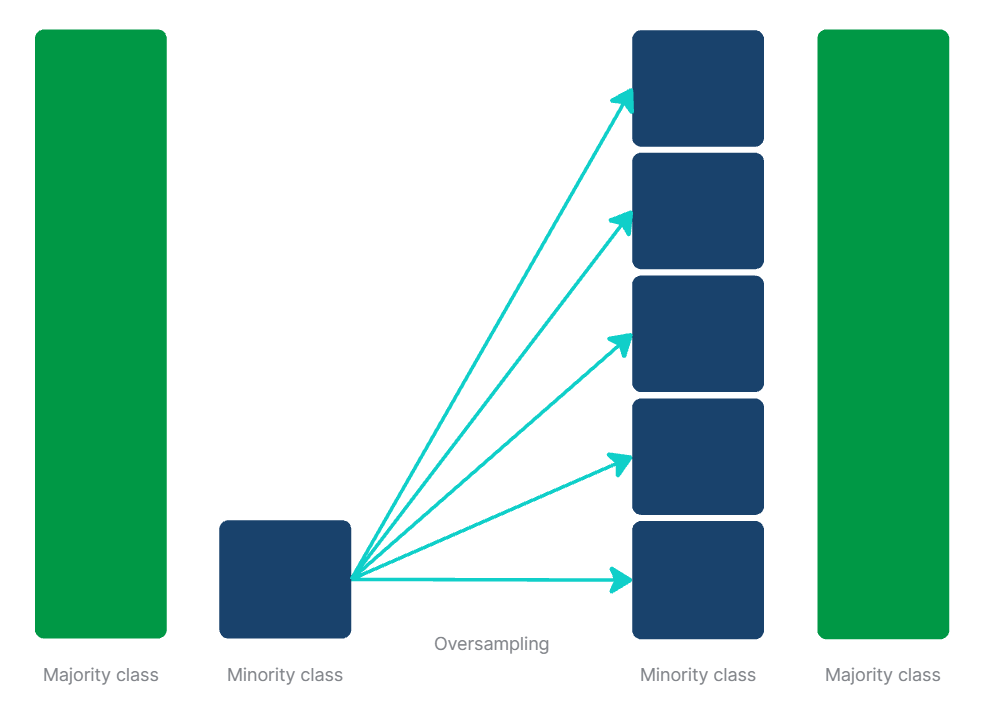

오버샘플링

소수 클래스에 충분한 데이터가 없는 경우 오버샘플링이 필요한 경우가 많습니다.

오버샘플링을 사용하면 소수 클래스를 나타내는 데이터 레코드가 추가됩니다. 구체적으로 말하면, 소수 클래스의 여러 샘플을 추출하여 원래 데이터 집합에 추가하는 과정이 포함됩니다.

그 결과, 다수 클래스와 소수 클래스가 더 잘 균형을 이룬 데이터 집합이 됩니다.

소수 클래스(파란색)를 과도하게 샘플링하여 다수 클래스(녹색)와 동등한 균형을 가져옵니다.

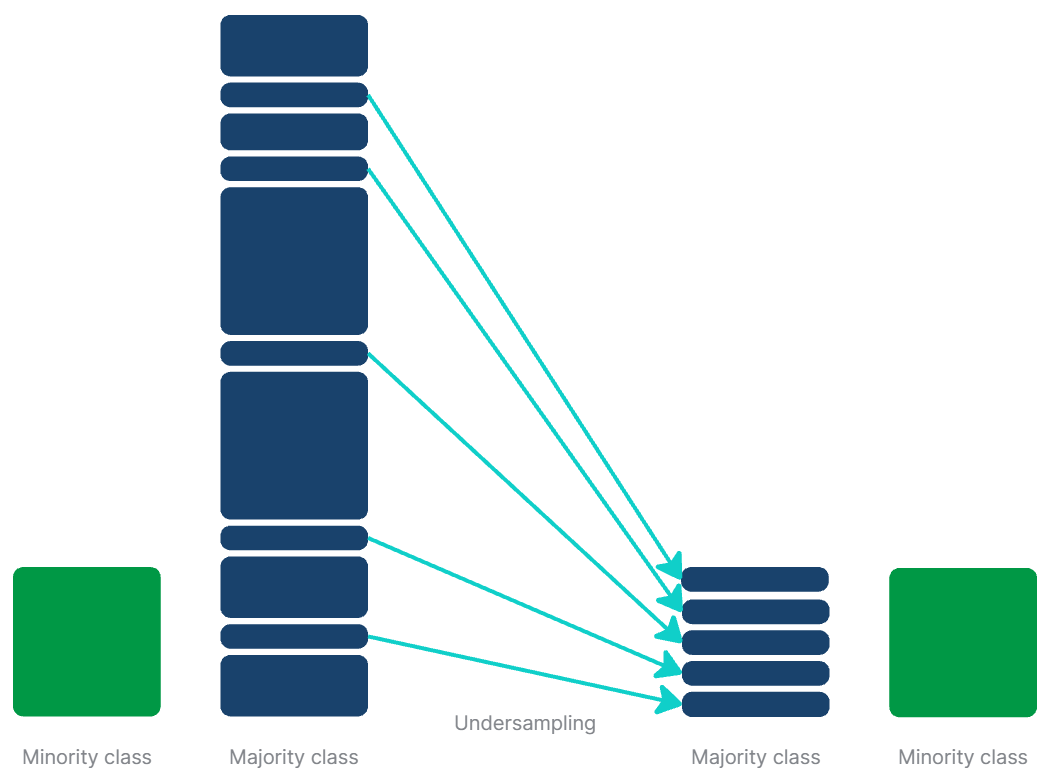

언더샘플링

데이터가 너무 많은 경우, 특히 다수 클래스에 대해 언더샘플링을 사용합니다.

언더샘플링을 사용하면 다수 클래스가 임의로 샘플링되어 소수 클래스와의 균형이 이루어집니다. 그림은 균형 조정된 클래스가 있는 데이터 집합을 가져오기 위해 원본 데이터 집합의 다수 클래스에서 샘플을 가져오는 방법을 보여 줍니다.

다수 클래스(파란색)를 샘플링하여 소수 클래스(녹색)와 동일한 균형을 가져옵니다.

Qlik 프로젝트에서 자동 클래스 균형 조정

이 도움말 항목에서는 필요한 경우 수동으로 클래스 균형을 조정하는 방법을 주로 설명합니다. 지능형 모델 최적화(새로운 ML 실험에서 기본적으로 활성화됨)를 사용하여 모델을 교육하는 경우 Qlik 프로젝트는 교육 프로세스 중에 자동으로 클래스 균형 조정을 수행합니다.

불균형 감지 및 사용된 특정 처리에 대한 자세한 내용은 클래스 균형 조정을 참조하십시오.