ビッグデータジョブの来歴を有効化

Atlasを使ってデータ来歴を設定

Apache Atlasのサポートが Sparkジョブで利用可能になりました。

ジョブの実行にHortonworks Data Platform V2.4以降を使用しており、HortonworksクラスターにApache Atlasがインストールされている場合は、Atlasを利用して特定のデータフローの来歴をトレースし、このジョブに使用されているコンポーネントおよびコンポーネント間のスキーマの変更を含め、このデータがSparkジョブによってどう生成されたかを確認できます。

CDP Private Cloud BaseまたはCDP Public Cloudを使ってジョブを実行しており、Apache Atlasがクラスターにインストールされている場合は、[Spark Configuration] (Spark設定)でSpark Universal 3.3.x (推奨)またはCloudera CDP 7.x (組み込み)を使ってAtlasを利用することもできます。

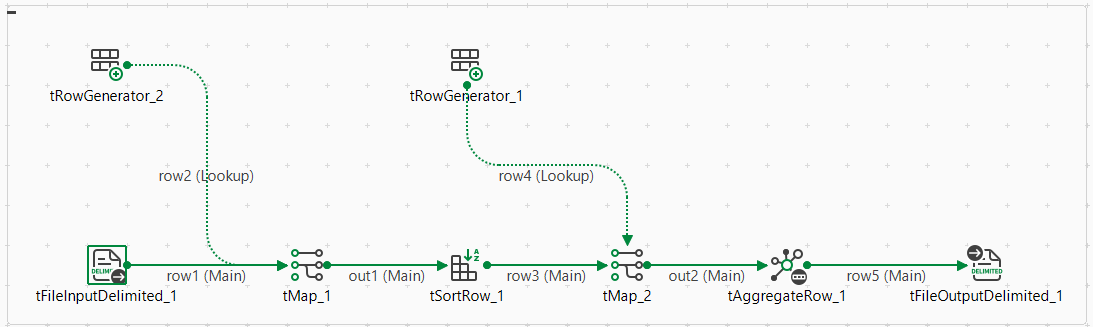

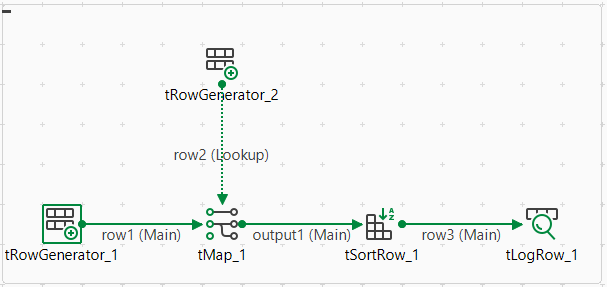

たとえば以下のSpark Batchジョブをデザインし、そこでAtlas内にそれに関する来歴情報を生成するとします。

このジョブでは、入力データの生成にtRowGeneratorを使用し、データ処理にtMapとtSortRowを使用し、データを別の形式に出力するのに他のコンポーネントを使用します。

- [Run] (実行)をクリックしてビューを開き、[Spark configuration] (Spark設定)タブをクリックします。

- [Distribution] (ディストリビューション)リストと[Version] (バージョン)リストからHortonworksディストリビューションを選択します。[Use Atlas] (Atlasを使用)チェックボックスが表示されます。

- [Die on error] (エラー発生時に強制終了): Atlasへの接続の問題など、Atlas関連の問題が発生した場合にジョブの実行を停止する場合は、このチェックボックスをオンにします。それ以外の場合は、解除してジョブが実行を継続できるようにしてください。

この時点までに、Atlasへの接続がセットアップ済みとなっています。このジョブを実行する時は、Atlas内に来歴が自動的に生成されています。ジョブを正しく実行するためには、[Spark configuration] (Spark設定)タブでさらにその他のパラメーターを設定する必要があります。詳細は、Spark Batchジョブを作成をご覧ください。

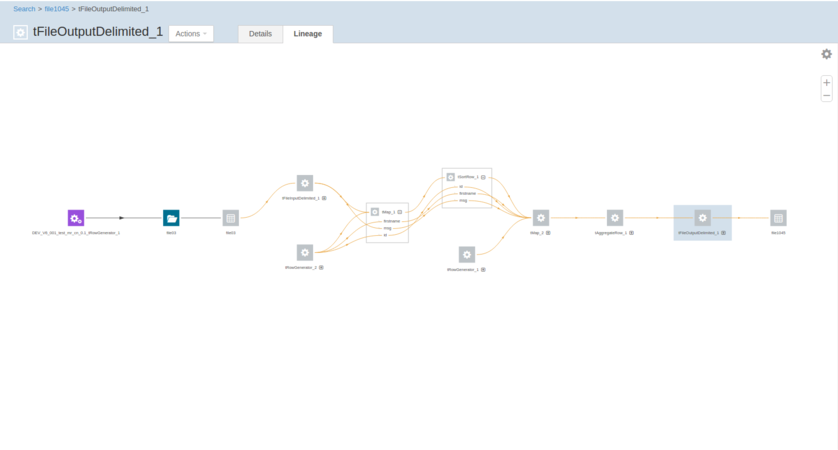

ジョブの実行が完了したら、このジョブによって書かれた来歴情報をAtlasで検索し、そこで来歴を読みます。

Atlas来歴を読み取り

-

-

ジョブ自体。

-

tRowGeneratorまたはtSortRowなど、データスキーマを使用するジョブ内のコンポーネント。tHDFSConfigurationなどの接続または設定コンポーネントはスキーマを使用しないため、これらは考慮されません。

-

-

Talend: ジョブによって生成されたすべてのエンティティに。

-

TalendComponent: すべてのコンポーネントエンティティに。

-

TalendJob: すべてのジョブエンティティに。

Atlasでこれらのタグの1つを直接クリックすれば、対応するエンティティが表示されます。